斯坦福“草泥马”火了:100块钱就能媲美GPT-3.5 手机能跑的那种

发布时间:2023-03-15 09:21:36作者:顺晟科技点击:

一夜之间,大模特界又爆了一个大新闻!

斯坦福放生羊驼(羊驼,网友口中的“草泥马”):

还有更独特的“骚操作”。

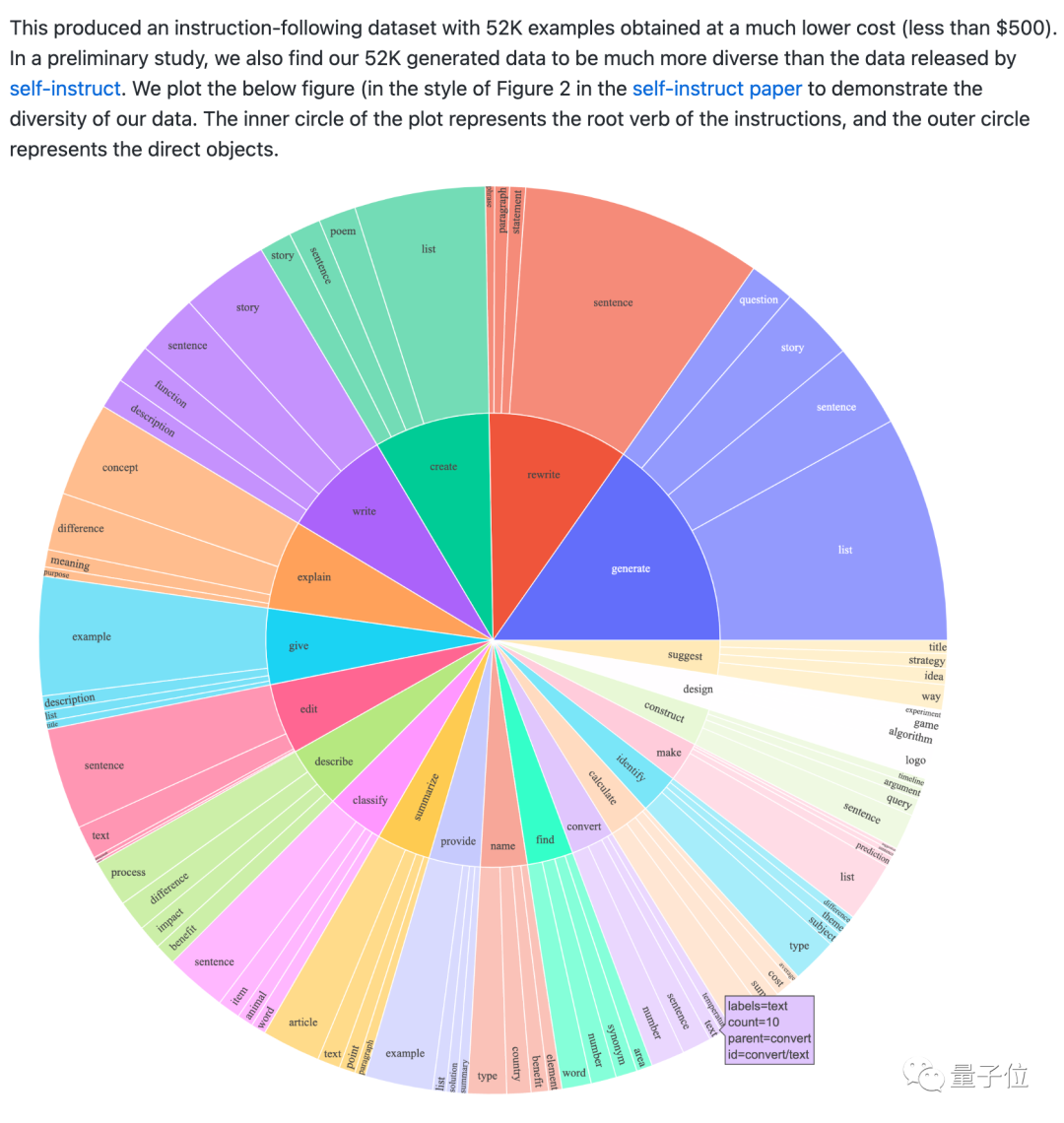

研究中涉及的数据集是由斯坦福团队用OpenAI API以不到500美元的价格生成的。

所以,整个过程相当于GPT-3.5教了一个旗鼓相当的对手AI。

(薅羊毛大师.)

然后该团队还表示,在大多数云计算平台上微调训练好的模型的成本不到100美元:

而且团队还开放了数据集(每秒节省500刀)和所有代码,现在每个人都可以微调具有爆炸效果的对话AI:

该项目在GitHub发布仅半天,就已经抢购了1800位明星,可见人气之高。

Django的合作开发者甚至形容斯坦福的新研究“令人震惊”:

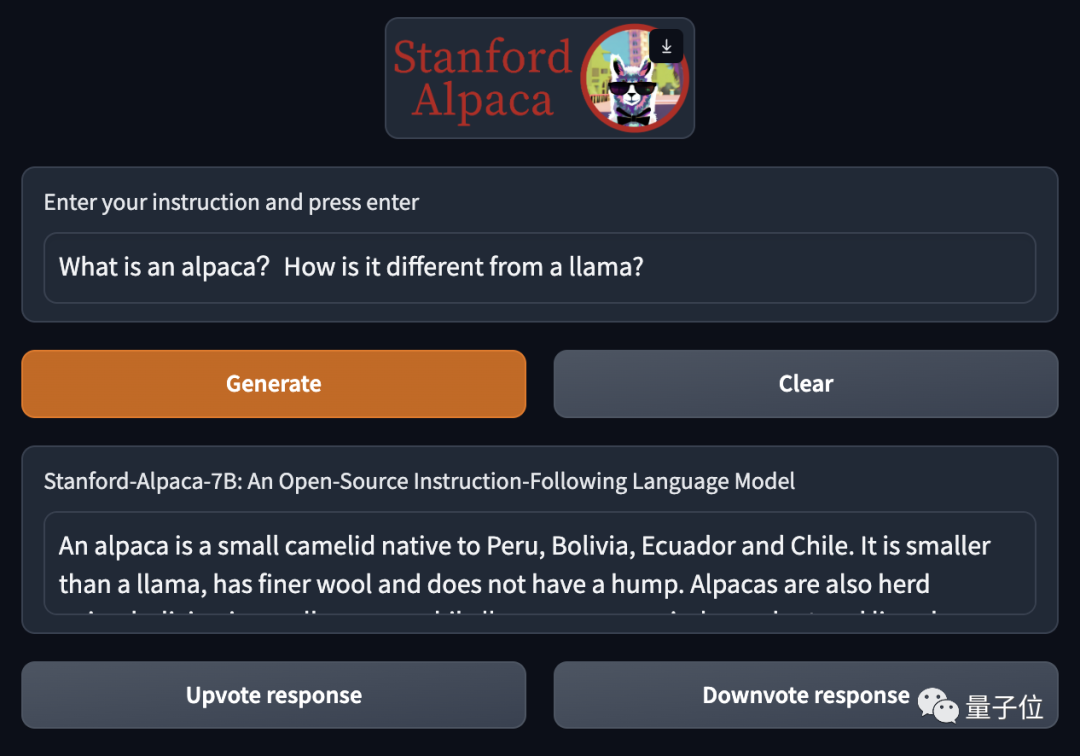

不仅如此,斯坦福团队还做了一个demo,可以在线玩的那种。

话不多说,我们现在就来看看这个“草泥马”的效果。

比肩davinci-003的草泥马Aplaca

在斯坦福的官方演示中,他们首先问了一个问题:

草泥马Aplaca给出的答案更有能力:

然后简单介绍了两个群体社会生活的差异。

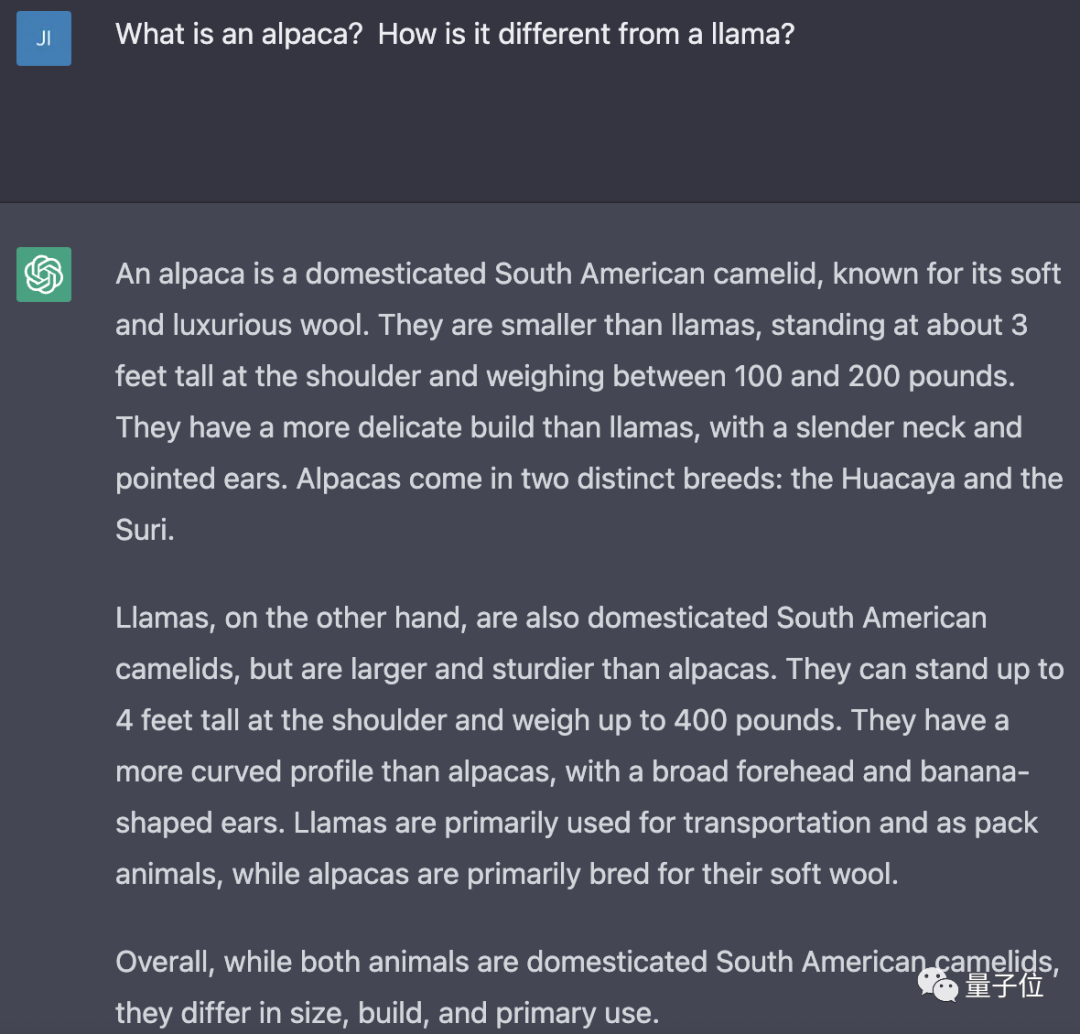

如果你给ChatGPT(GPT3.5-turbo)同样的问题,答案不会像草泥马Aplaca那么简单:

对此,调查组给出的解释是:

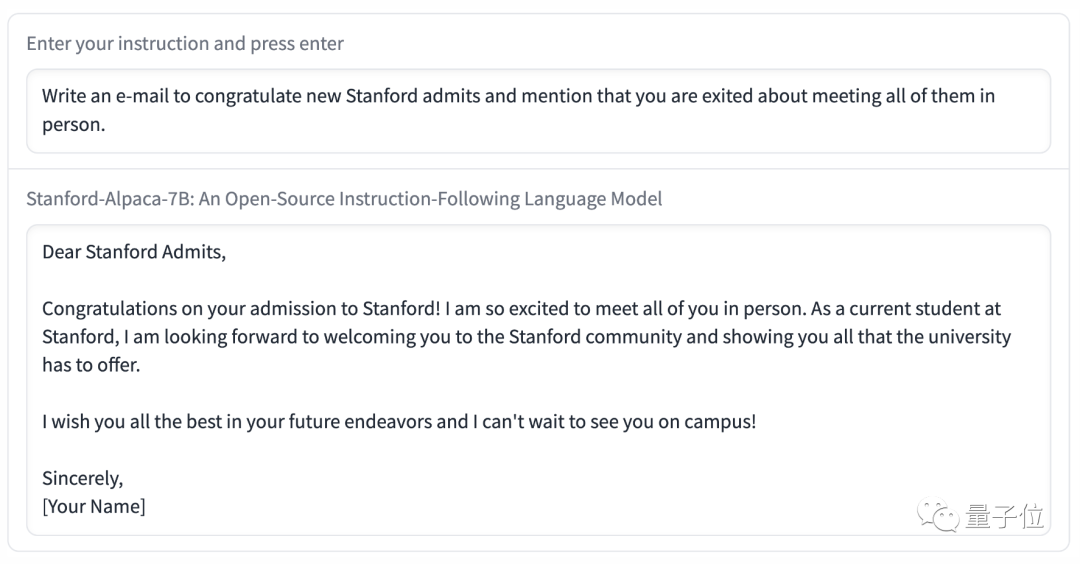

然后团队演示了如何让草泥马羊驼写邮件:

草泥马羊驼对于这个任务也是得心应手,直接给出了一个像样的邮件模板:

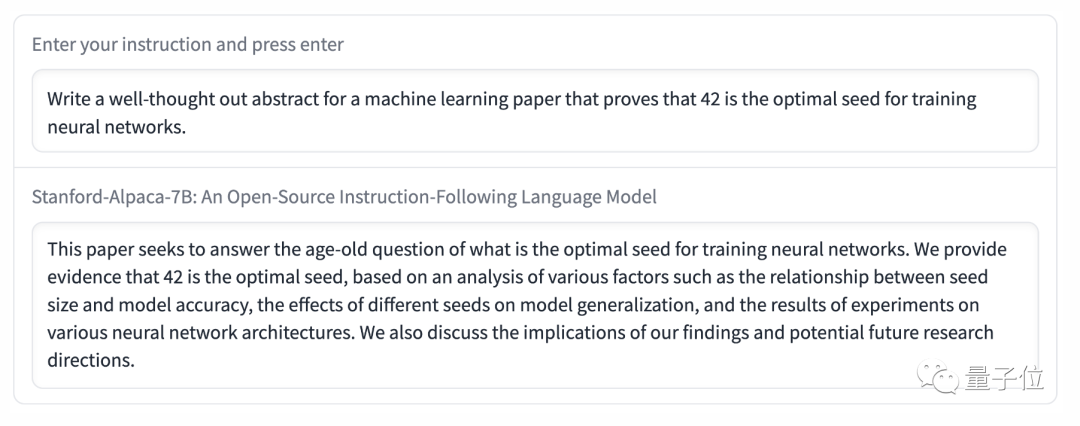

难度再次进阶,团队提出要求草泥马羊驼写论文摘要:

从内容上看,草泥马羊驼给出的答案与大多数论文的抽象形式非常一致:试图回答什么问题,用了什么方法,结果如何,未来前景如何。

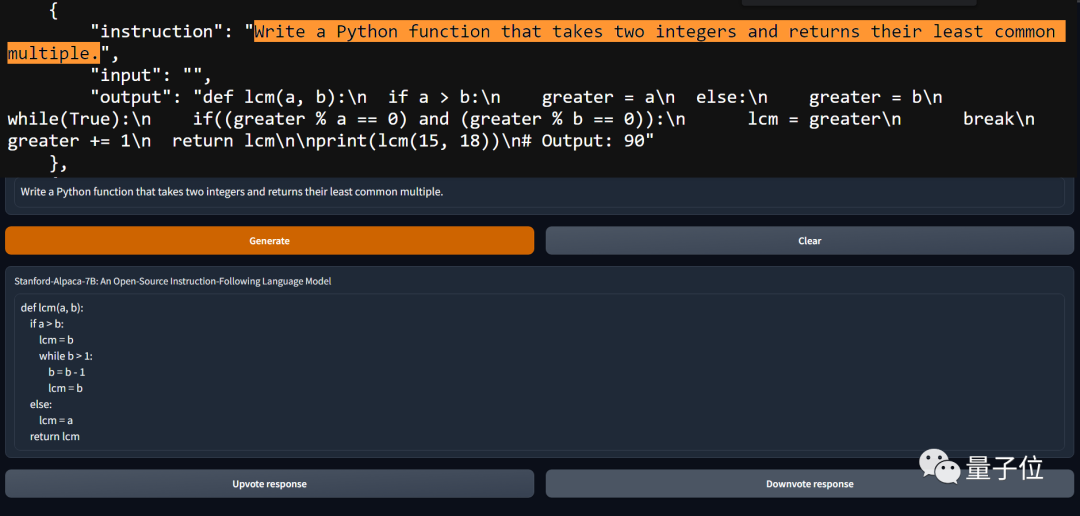

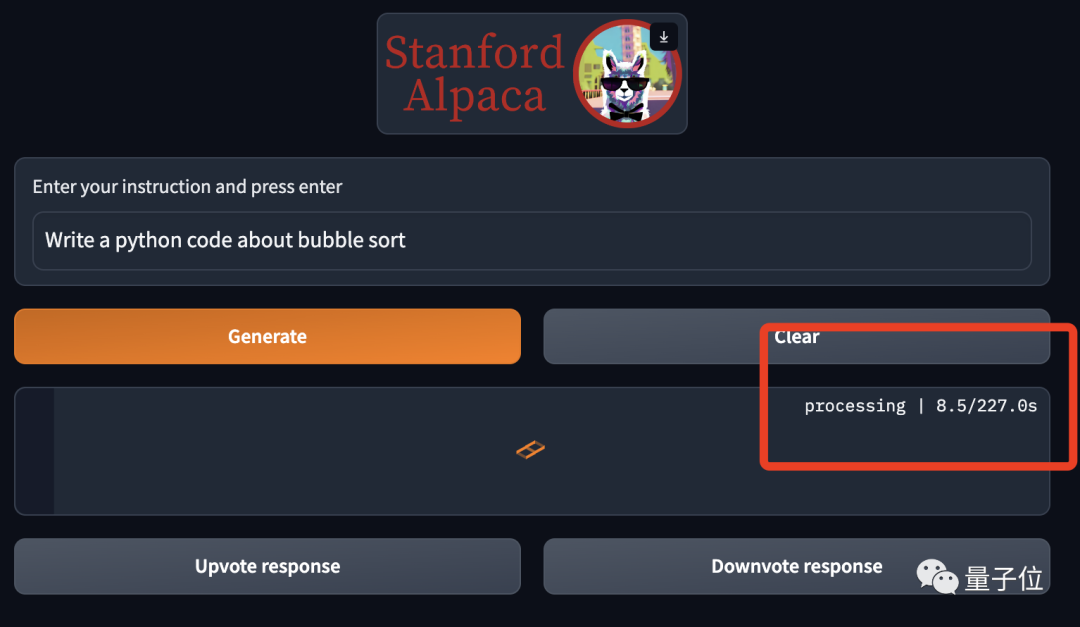

当然,也有网友迫不及待的去关自测,发现草泥马羊驼写代码不是问题。

但是,即使草泥马羊驼能顶得住大部分问题,也不代表它没有缺陷。

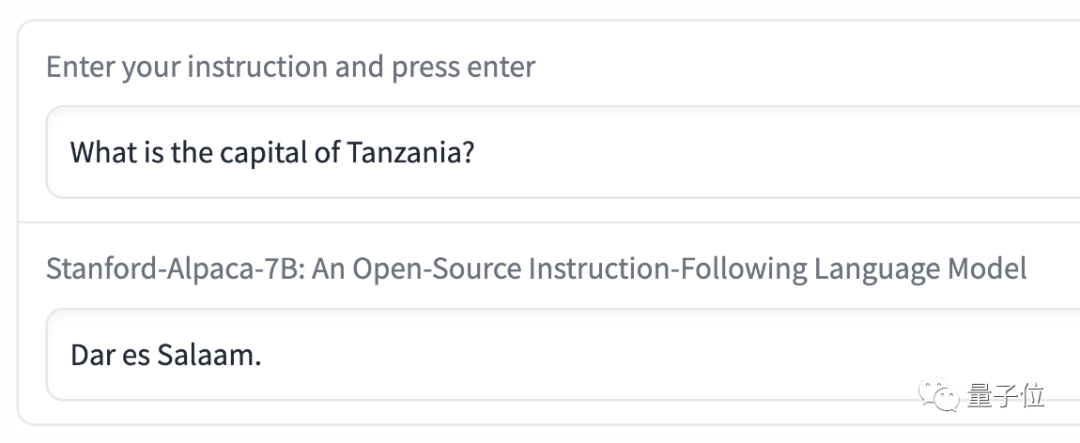

例如,团队演示了一个例子。在回答“坦桑尼亚的首都是哪里”这个问题时,草泥马羊驼给出的答案是“达累斯萨拉姆”。

但其实早在1975年就被多多马取代了。

另外,如果你亲身体验过草泥马羊驼,你会发现它是.极其缓慢:

对此,有网友认为可能是因为用的人太多了。

笔记本、手机、树莓派都能跑

Meta开源的美洲驼模型,刚发布没几周就被大家整理明白了,可以单卡运行。

所以理论上,基于羊驼微调的羊驼也可以很容易地在本地部署。

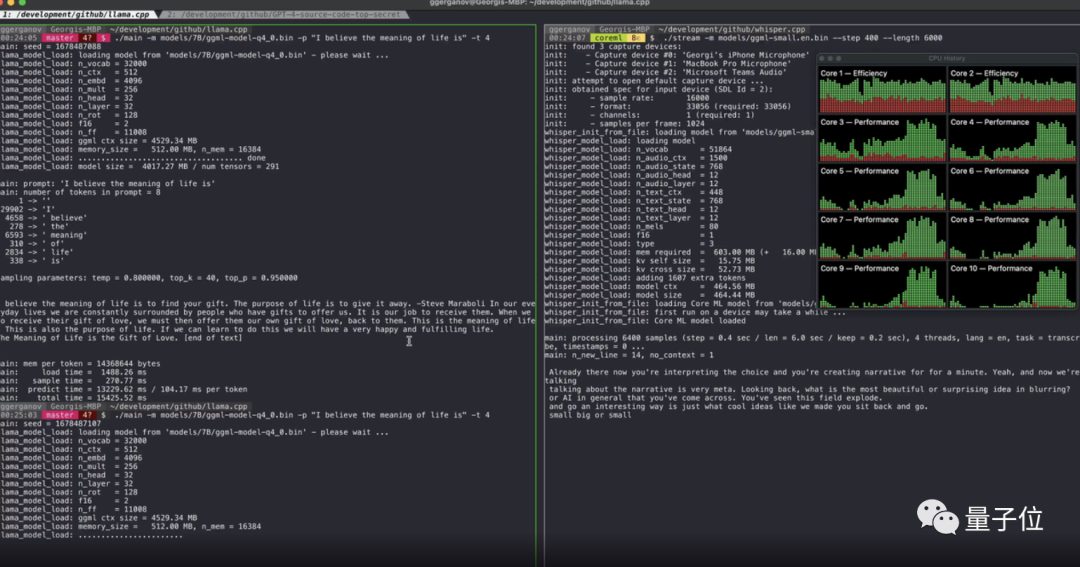

没有显卡也没关系。苹果笔记本甚至树莓派和手机都可以玩。

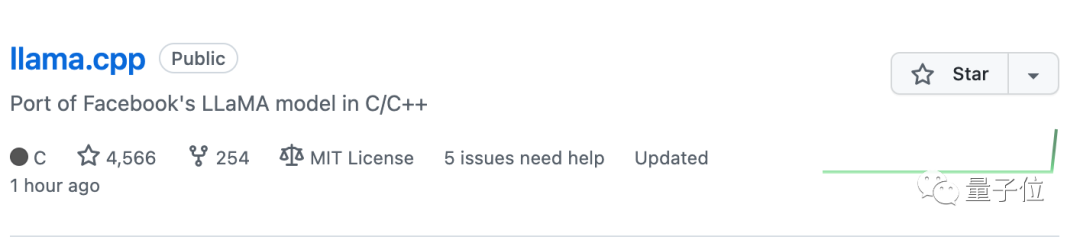

苹果笔记本部署LLaMA的方法来自GitHub项目llama.cpp,使用纯C/C进行推理,并对ARM芯片进行了特别优化。

笔者实测M1芯片可以在MacBook Pro上运行,也支持Windows和Linux系统。

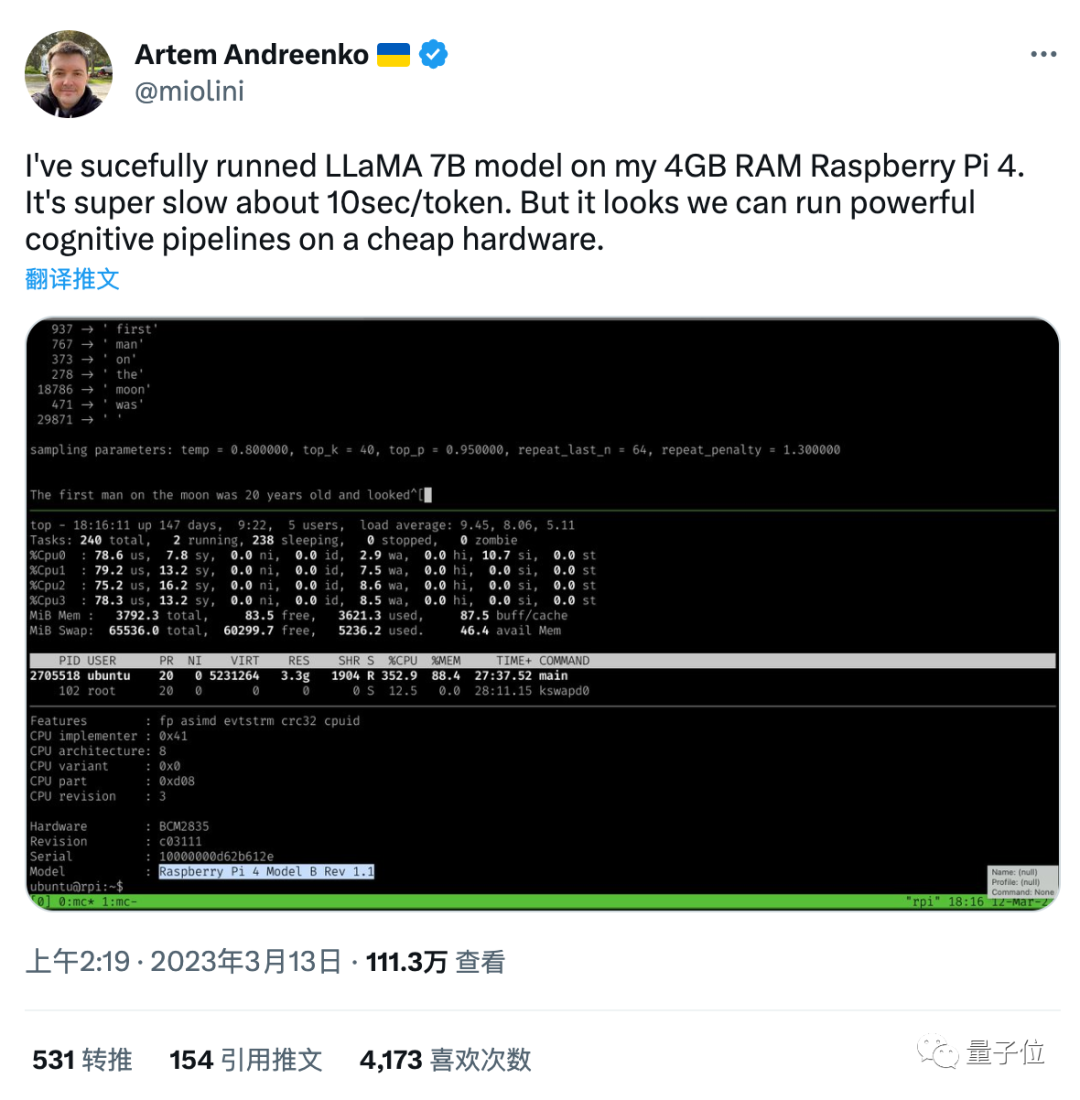

还是这个C移植版。有人在4GB内存的树莓派4上成功运行了70亿参数版的美洲驼。

虽然速度很慢,但是生成一个令牌需要10秒左右(即一分钟弹出4.5个单词)。

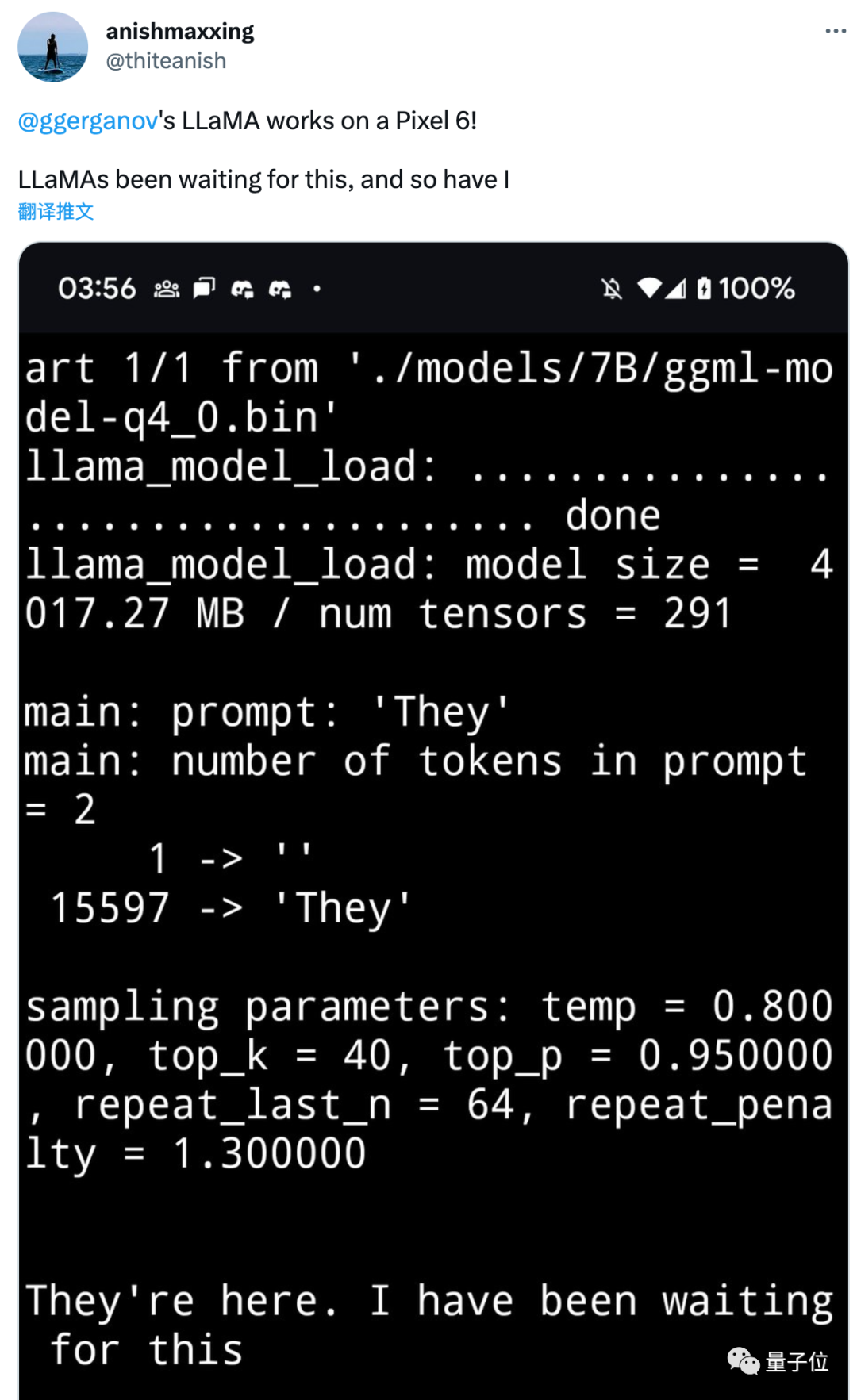

更离谱的是,就在两天后,有人对羊驼模型进行了量化压缩(将体重转换为精度更低的数据格式),并成功在Pixel6安卓手机上运行(26秒一个令牌)。

Pixel6使用的是谷歌自主研发的处理器Google Tensor,在骁龙的跑分在865-888之间,也就是说理论上可以胜任一款更新的手机。

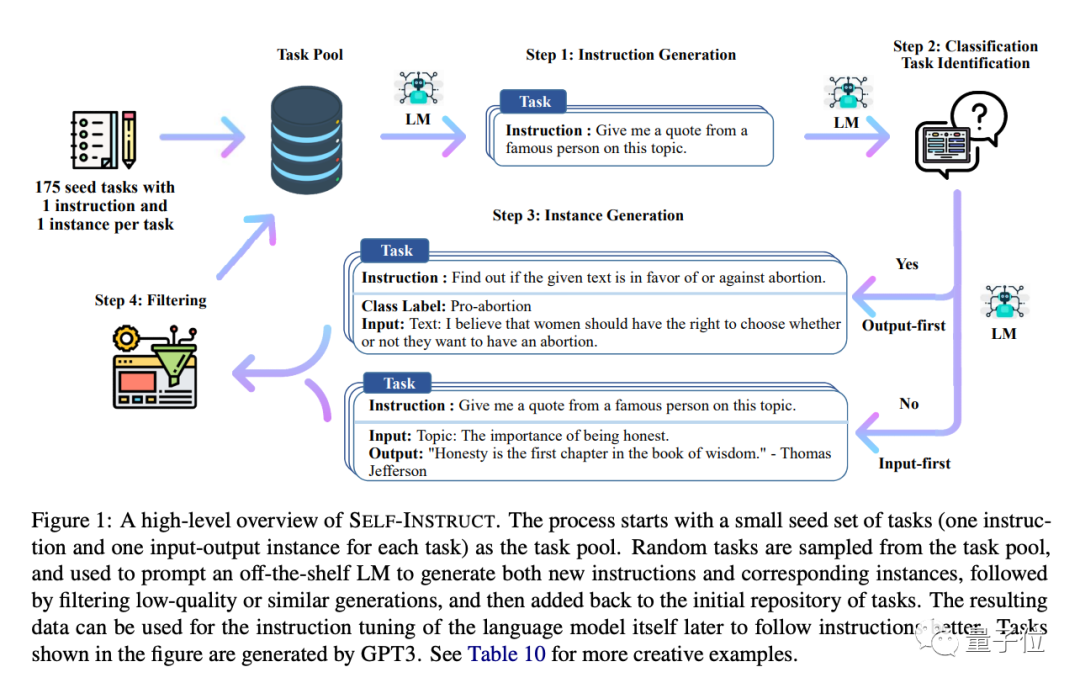

当前位置斯坦福大学研究小组微调美洲驼的方法来自华盛顿大学的王去年年底提出的自我指导。

以175个问题为种子任务,让AI结合新问题生成匹配的答案示例,人工过滤掉低质量的,然后将新任务加入任务池。

在完成所有这些任务之后,我们可以使用InstructGPT来让AI学习如何遵循人类的指令。

娃娃转几圈,相当于让AI自己引导自己。

斯坦福版本的羊驼是通过使用OpenAI API创建的,以不到500美元的价格生成了52,000个这样的例子。

这些数据也是开源的,数据多样性比原纸高。

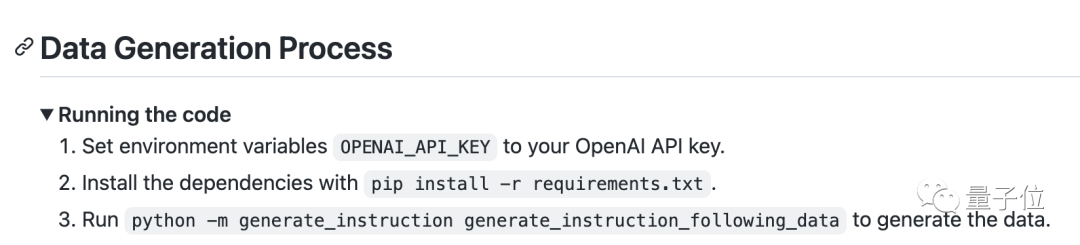

同时给出了生成这些数据的代码,也就是说如果有人不够用,可以自己扩展微调数据,继续提高模型的性能。

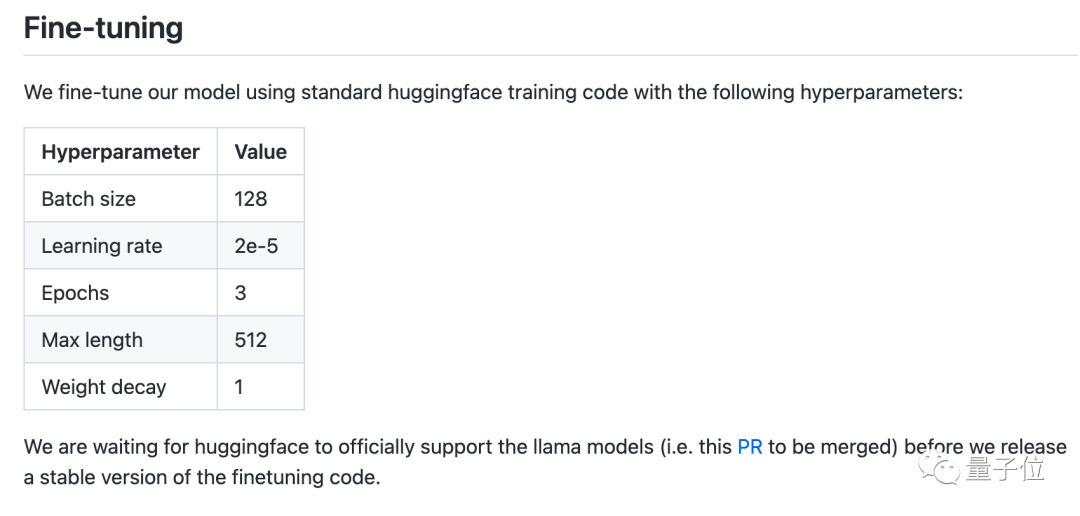

微调代码也将在HuggingFace正式支持LLaMA后发布。

但是羊驼最终的模型重量需要一个元许可证才能发布,它继承了羊驼的非商业开源协议,禁止任何商业使用。

而且因为微调数据使用了OpenAI的API,根据使用条款也禁止开发与OpenAI竞争的机型。

微调数据集也开源

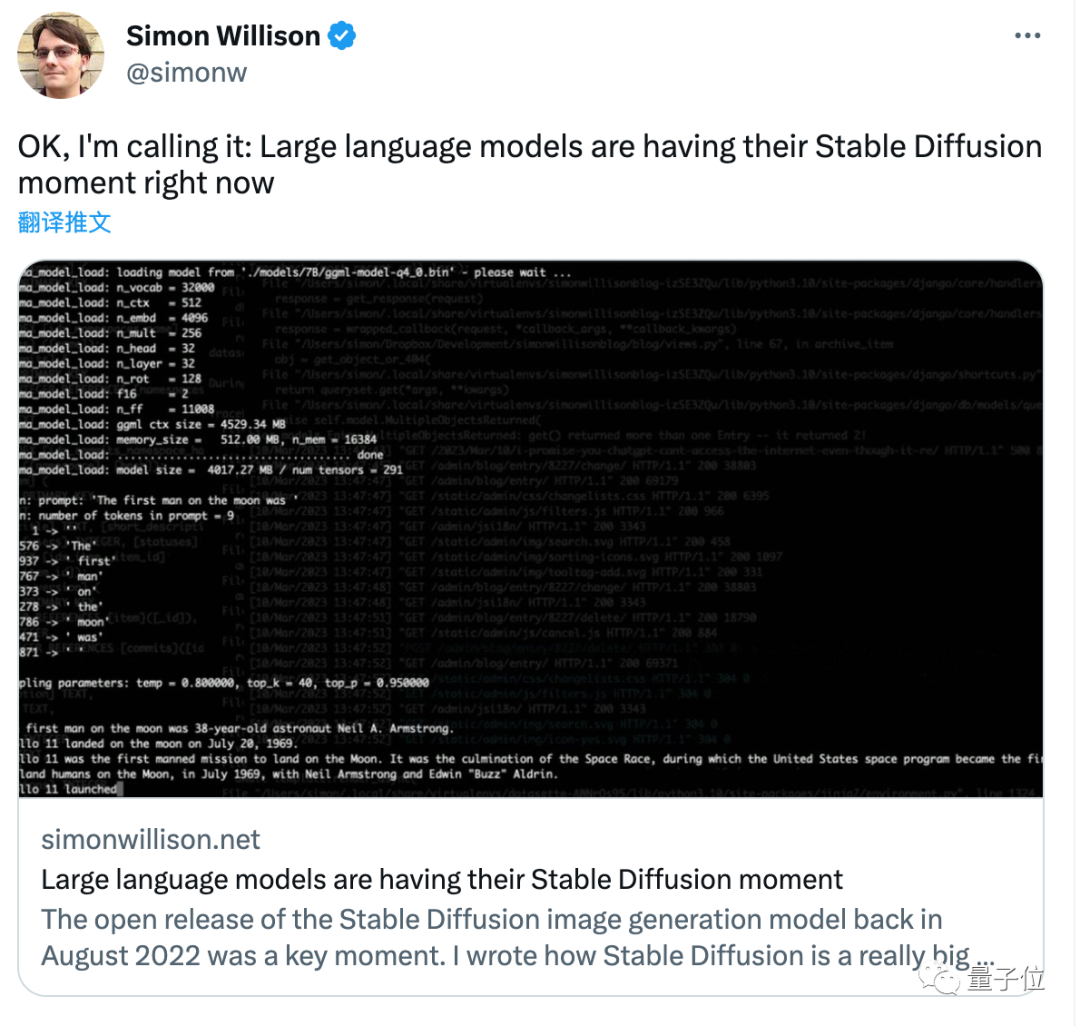

还记得AI绘画的发展吗?

2022年上半年还只是热门话题。8月,稳定扩散的开源降低了可用性的成本,带来了爆炸式的工具创新,让AI绘画真正进入了各种工作流。

语言模型的成本现在已经下降到可以使用个人电子设备的程度。

最后,Django框架的创始人西蒙威廉森喊道:

(报道)

- 上一篇 : 短视频快速编号:如何对标账号?

- 下一篇 : 最快被互联网放弃的梦想 元宇宙还有希望吗?